你听说过Deepfake换脸技术吗?

早前,网路上突然流传多位网红、实况主、艺人,甚至是政治人物的不雅视频,在警方侦查后发现,该“台湾网红挖面”的Telegram群组背后,竟是由台湾百万YouTuber小玉(朱玉宸)在操纵,他们利用换脸技术将各界名人换成AV成人视频的主角,以此赚取暴利。10月18日,警方也将小玉及其公司员工等3人,依涉嫌散播猥亵物与妨碍名誉等罪解送新北地检署侦办。

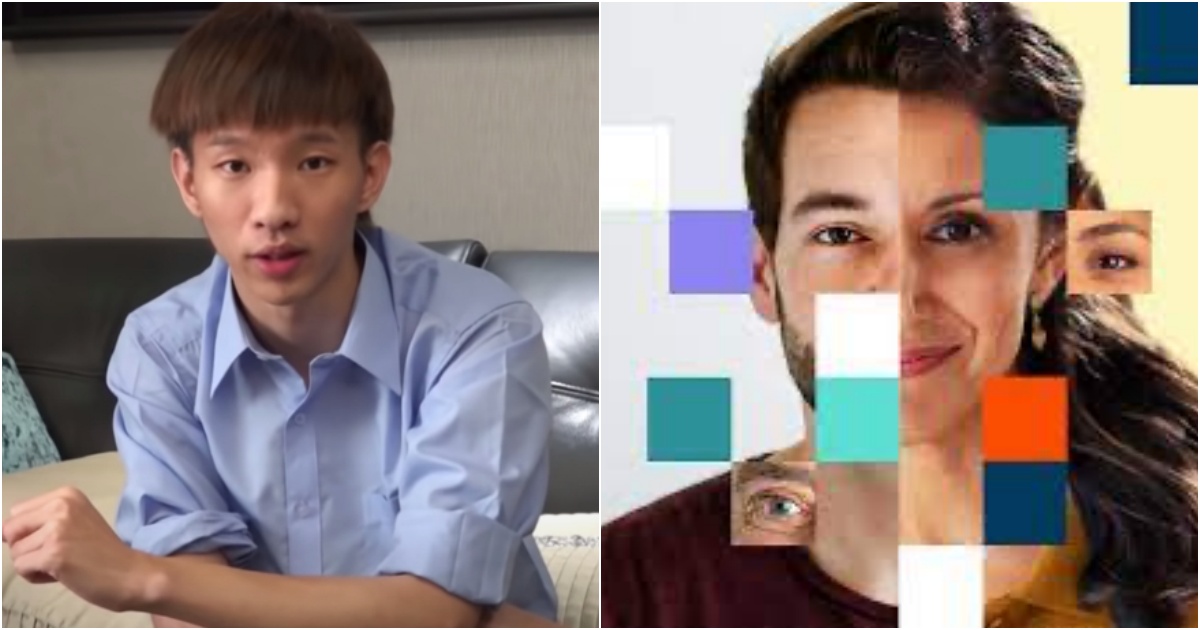

其实早在2020年的愚人节当天,小玉就上传过一则视频。在视频中,前高雄市市长韩国瑜身穿蓝色衬衫,用夸大的言词说着无厘头的话。

小玉随后解释道,这是为了向民众呼吁假新闻的风险,利用Deepfake技术所制造出来的假视频,并称“我花了150块人民币买下的AI换脸软件(视频中所使用的技术),只花30分钟和一个配音员,我可以让韩国瑜讲出任何我想要他讲的话”,而该视频很快就上了热门视频排行,如今他却利用相同技术犯罪,他是幕后主谋的消息一出,瞬间引起网民热议。

Deepfake到底是什么?

Deepfake,中文可译成“深假”或是“深伪”,它其实是“Deep learning”(深度学习)和“Fake”(伪造)结合而成的新单词。简单来说,就是一种可以实时伪造人物表情,并将其渲染成2D合成视频的人工智能技术。

这种换脸技术最早被用于影视后期制作,但因为操作起来非常复杂,因此只有专业剪辑师或是相关专家才能完成,并且需要花费大量的时间和精力。然而,随着Deepfake技术的使用门槛越来越低,许多相关APP也不断涌现,例如以“变老挑战”走红的FaceApp、可以通过“换脸”形式出演电影和电视剧的ZAO或是今年8月仅上线一周,下载量就达200万以上的FacePlay。

有了这些APP,即使是一个对视频剪辑一窍不通的普通人,只需30秒,就能利用这些APP完成换脸并且做出以假乱真的视频效果。

Deepfake技术原本是为了方便人类文明与便利,例如在艺术和文化领域,Deepfake技术就被用来进行艺术创作、增加美术馆的用户参与度,研究员们利用该技术让画作和已经过世的艺术家“复活”,为观众提供全新的参观体验。

而该技术最典型的案例莫过于就是《速度与激情7》,当年保罗·沃克在拍摄期间不幸因车祸去世,他的弟弟代替哥哥出镜,而制作团队利用CG技术和动作捕捉系统,再根据保罗·沃克在前作中的影像资料,最终通过“真人拍摄+CG技术”结合的方式完成了这部电影。

“失控”的Deepfake

事实上,一开始这只是Deepfake的“自娱自乐”,然而在不法分子的使用下,事件逐渐变得失控。即使Deepfake在马来西亚尚未被广泛运用,但在西方国家却已经成为国际媒体讨论的焦点。

早在2017年12月,在国外论坛Reddit上突然出现一位名为“Deepfakes”的用户,他将多位国外知名艺人,包括《神奇女侠》主角盖尔·加朵(Gal Gadot)、黑寡妇斯嘉丽.约翰逊(Scarlett Johansson)、泰勒·斯威夫特(Taylor Swift)等人的脸嫁接到色情影片中,这直接引发了众怒。虽然Reddit稍后封掉了这个账号以及相关的群组,谷歌、推特等网站也陆续禁止相关搜索,但Deepfake并未真正的消失,类似的情况还是屡禁不止。

重要的是,Deepfake不仅可以换脸,还可以伪造声音。2018年末,美国演员乔丹.皮尔(Jordan Peele)与BuzzFeed合作制作一段“假”视频。在视频中,AI以皮尔的发言作为基础,再将皮尔的声音转变成奥巴马的声音,然后将他的脸部表情和嘴形与发言内容相匹配,重点是整段视频看起来没有丝毫违和感。而他们制作视频的初衷也是为了向人们发出警告,那就是“Deepfake将走进我们的日常生活”。

在去年轰动全网的韩国“N号房”事件中,警方也在Telegram上发现了四个“成人换脸合成物”的专用聊天室,而换脸对象均为韩国女艺人,甚至在某个以女性偶像歌手为主题的换脸房内,超过2000名会员都上传了换脸照片和视频。

根据Sensity于去年的调查分析表明,2019年7年,互联网上共有1.5万个换脸视频,其中96%是色情视频,只有剩下的一小部分来自商业、新闻媒体以及政治领域,视频中的主角大多是女性。截至去年12月,互联网上的有害换脸视频数量已经超过8.5万,而影视娱乐仍然是覆盖最广的行业。据专家观察,这些换脸视频数量每六个月就会翻一倍,但在互联网的隐秘处,可能有更多的换脸视频并不能被检测到,数量只会更多而不是更少。

Sensity公司首席执行官兼联合创始人乔治.帕特里尼(Giorgio Patrini)称,“诽谤性、贬损性和色情性的假视频仍然占大多数,达到93%”。

下一个受害者可能就是你

事情发展到这,还远没有结束。尽管在人们眼中,这些事情似乎永远不会发生在自己身上,事实上在这种技术遭滥用的情况下,每个人都可能成为潜在的受害者。

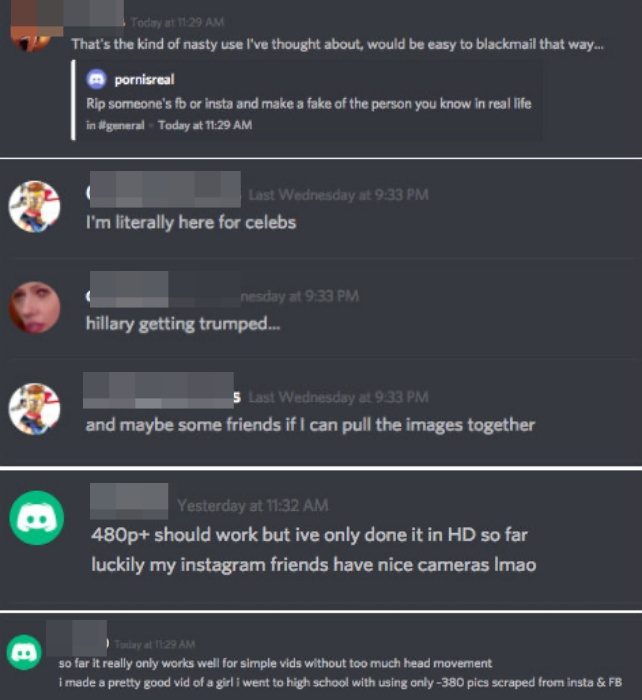

此前,在社交软件Discord的一个名为“deepfakes”的聊天小组中,一些用户就声称他们正在利用身边熟人和朋友的素材,制作这种伪色情视频。虽然Discord已经关闭这个聊天小组,但是也不能排除在互联网的某个角落,仍然有这样的事情发生。

在如今的社交网络,无论是想要找一个人的照片或资料,都十分简单,这也导致普通人很容易成为这项技术的受害者。在社会新闻版面上,分手后利用“报复性色情视频”要挟的事件也屡见不鲜,这类基于报复或其他目的的色情视频,可能让女性面临更高的名誉风险而难以自辩。

深受其害的著名女演员斯嘉丽曾表示,“这对我的影响没有那么大,因为人们知道色情视频里的人并不是我,但是对于那些因此可能丢掉工作的人来说就不同了”。

在澳洲生活的印度裔女性Noelle Martin就是其中一名受害者。2018年,她在Ted Talk上分享自己从18岁起就被身边不知名男性“色情报复”,照片被人做成色情视频发到网上的可怕经历。去年,在接受《ELLE》采访时,她表达了当时的震惊,“我亲眼看着我的脸、眼睛、嘴巴在屏幕上动,太逼真了,连我自己都信了。但只有脸是我,身体却是别人的。”

随着Deepfake技术日新月异,当中所涉及的犯罪领域也不断扩大,成为了有心人的操控工具。第一起利用Deepfake的诈骗出现于2019年,当时歹徒以Deepfake技术制作了一段语音,诱骗英国某高阶经理将24万美元汇到某个歹徒所开设的账号。在电话中,歹徒不仅能模仿被冒充者的声音,还能模仿其腔调、断句以及语气。

这就是Deepfake的可怕之处,它可以用来伪装成一个不存在的人,伪造一个从未发生过的事,或者把某个人做的事放在另一个人身上,从而误导不明真相的人,混淆视听。

“换脸技术”的泛滥,难道就不能遏止吗?

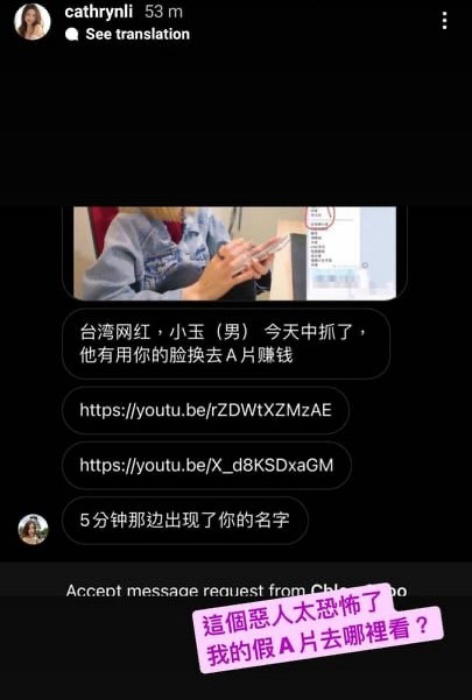

回到此次的“小玉换脸事件”。台湾知名YouTuber奎丁在去年10月就曾控诉自己遭“台湾网红挖面”Telegram群组换脸成了色情片的女主角,引发外界关注。在警方接获检举并追查后发现,自去年起,网路上就开始流传多名网红的不雅影片,但该影片都不是本人所拍摄的,直到本月18日才抓获幕后主谋小玉。

小玉利用Deepfake技术,将网红或艺人的面部五官移植到成人片的演员身上,并制作成色情片盈利贩售。许多人为了能收看这类视频,便支付数百元台币不等的会费给小玉,加入他经营的私密聊天群组,在线上浏览完整的色情片。

截至今年10月初,根据网友整理的完整名单,影片受害者高达上百人,当中以YouTuber、艺人占大数,另外还有政治人物、实况主、国外艺人、网红、主播等。受害者名单包括台湾立委高嘉瑜,多位知名YouTuber包括笑笑(小玉搭档)、愛莉莎莎、白痴公主、理科太太、木星、茵声、众量级家宁等人,多位知名艺人如柯佳嬿、蔡依林、吴怡霈等,就连大马艺人林明祯、李元玲也在受害者名单上,让人看了瞬间毛骨悚然。

事件爆出后,各个艺人网红,例如许蓝方、吴怡霈、米砂、馆长陈之汉,甚至是蔡英文等人皆纷纷发文讨伐及提告。大马“钢琴女神”李元玲也在社交平台上解释道,自己虽然会在社交平台上传一些性感照,但从不会有露点或不雅片,她也很担心妈妈在看到假视频后会误以为当中主角真的是她。

就目前使用该技术的结果而言,Deepfake技术对人们的影响似乎是弊大于利。因此,在去年1月和2月,脸书和推特就宣布将会下架Deepfake影片,而脸书、谷歌和微软等也开始致力于开发与Deepfake抗衡的检测技术,甚至脸书还举办了Deepfake侦测竞赛(Deepfake Detection Challenge)。

而Adobe也发明了检测图像是否经过PS的工具,可以识别图片有没有被修过的痕迹。以查破社交平台假账号起家的以色列新创Cyabra全球业务副总裁阿赛夫.丹比(Assaf Danby)也表示,透过他们所开发的AI演算法,找出Deepfake的准确率可高达97%。

相比技术的突飞猛进,法律程序却显得有点落伍。以美国为例,由于视频中出现的只有受害者的脸而非身体,因此无法达到起诉门槛。所幸的是,现在世界各地都纷纷采取行动来解决该问题,欧盟于今年4月提出的《人工智慧法案》中,就要求使用AI技术生成图片与影音的人必须告知何时操作该内容,在英国目前也有一项相关的《私密形象滥用法》正在被讨论,韩国也有不少相关立法处于讨论阶段。

技术本无善恶,Deepfake可以被运用于趣味视频、游戏、戏剧以及广告合作中,但恶意运用也会带来严重后果。在这个真假难辨的世界里,人们都应该谨记一件事情,那就是文字、图片、音频和视频都有可能是伪造的,不能轻易相信网络上的所有信息。不然结果就会像斯嘉丽曾说的,“互联网就像是一个巨大的黑洞,正在将自己吞噬”。